IVRロボットIVR Robot

Interventional Radiology Robot

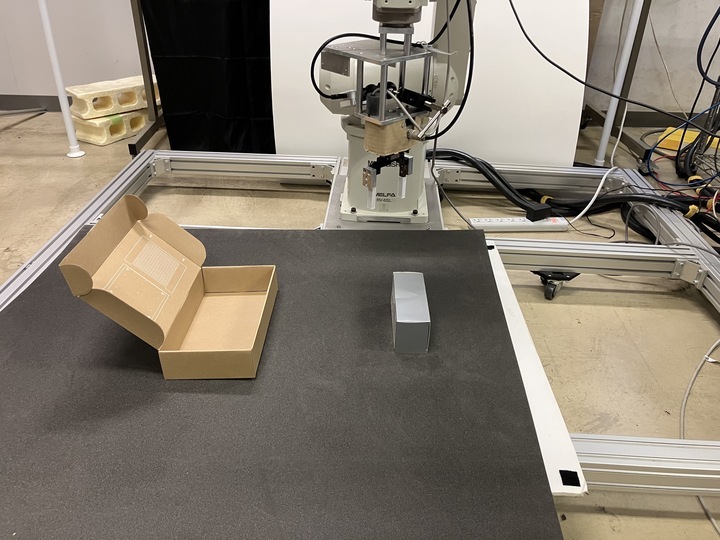

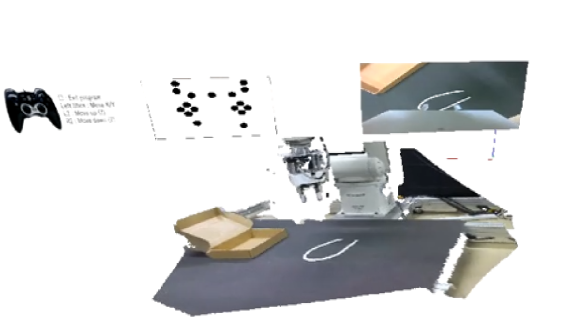

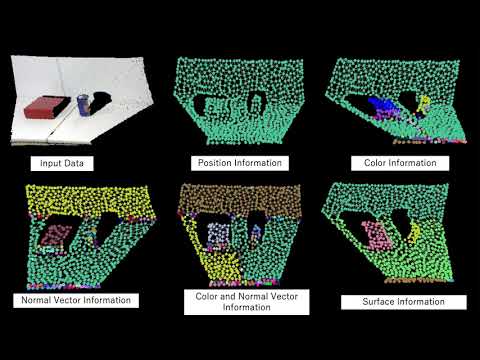

肺がんに対するラジオ波焼灼療法(RFA)を支援する遠隔操作ロボット「Zerobot」の開発を行っています。医師はCTガイド下で針を手動操作する際に被曝リスクを伴いますが、Zerobotを用いることで遠隔から高精度な針刺入が可能となり、被曝を大幅に低減できます。インターフェースシステム学研究室との共同研究のもと、2018年には岡山大学病院にて10名の患者を対象とした臨床試験を実施し、安全性が確認されました。RFAは外科手術と比較して低侵襲であり、局所麻酔下で実施可能、術後回復も3〜4日と短い利点があります。

We develop "Zerobot," a teleoperated robot for CT-guided radiofrequency ablation (RFA) of lung cancer. Physicians currently risk radiation exposure when manually inserting needles under CT guidance; Zerobot enables precise remote needle insertion, significantly reducing exposure. In collaboration with the Interface System Laboratory, clinical trials at Okayama University Hospital (2018) confirmed safe needle insertion in ten patients. RFA is minimally invasive, feasible under local anesthesia, and requires only 3–4 days of recovery compared to open surgery.